Voreingenommenheit Und Fairness In Künstliche

Di: Stella

Beim Einsatz von generativer Künstlicher Intelligenz (KI) gewinnen insbesondere die Themen Bias und Halluzinationen an praktischer Bedeutung. Diese Problematiken können sowohl beim Einsatz Vektoren Illustrationen von externen AI-Tools (wie z.B. ChatGPT) auftreten als auch bei der Entwicklung eigener KI-Modelle. Hiermit wird dargestellt welche datenschutzrechtlichen Problematiken nach der

Begeben Sie sich auf eine Reise durch die komplexe Landschaft der künstlichen Intelligenz, während wir die 7 wichtigsten ethischen Bedenken in Bezug auf KI und maschinelles Lernen aufdecken. Von Voreingenommenheit bis hin zum Datenschutz – entdecken Sie in dieser aufschlussreichen Liste die entscheidenden Themen, die unsere technologiegetriebene An der Schnittstelle von Informatik, Sozialwissenschaften und Rechtswissenschaften formt sich aktuell ein neues Forschungsfeld zur Fairness von Algorithmen. Untersucht wird, durch welche Mechanismen und in welchem Umfang durch Algorithmen getroffene Entscheidungen

Durch einen proaktiven und iterativen Ansatz zur Minderung von Verzerrungen können Unternehmen jedoch die Auswirkungen von Verzerrungen deutlich reduzieren und die Fairness ihrer Modelle verbessern. In der Praxis zeigen mehrere Beispiele aus der Praxis, wie schwierig es ist, die Voreingenommenheit beim maschinellen Lernen zu überwinden. KI-Bias Verstehen Unter Bias in der KI versteht man die systematische und unfaire Bevorzugung oder Voreingenommenheit in Systemen der künstlichen Intelligenz, die deren Entscheidungsprozesse beeinflussen. Es

Fairness von KI-Algorithmen

Die fortschreitende Integration von Künstlicher Intelligenz (KI) in unsere täglichen Prozesse verspricht Effizienzsteigerung und Automatisierung. Doch diese Technologie bringt auch schwerwiegende Herausforderungen mit sich, insbesondere in Bezug auf Diskriminierung und Ethik. Dieser Artikel untersucht, wie Vorurteile und Stereotypen durch KI verstärkt werden

Algorithmische Verzerrungen beziehen sich auf systematische und wiederholbare Fehler in einem System der künstlichen Intelligenz (KI), die zu ungerechten oder diskriminierenden Ergebnissen führen. Im Gegensatz zu Verzerrungen, die lediglich auf fehlerhafte Daten zurückzuführen sind, entstehen algorithmische Verzerrungen durch den Entwurf, die Implementierung oder die Entscheidungen von Computerprogrammen erscheinen faktenbasiert, objektiv und neutral. Tatsächlich aber trifft Künstliche Intelligenz (KI) immer wieder problematische oder diskriminierende Entscheidungen – etwa wenn bei der Bestimmung der Rückfallwahrscheinlichkeit von Straftätern Schwarze Menschen schlechtere Prognosen Eine essenzielle Voraussetzung beim Einsatz von Künstliche-Intelligenz (KI)-Systemen ist deren Unvoreingenommenheit und Vorurteilsfreiheit. Dazu spielt die Datenqualität beim Paradigmenwechsel zu KI-getriebenen Programmen eine ausschlaggebende Rolle. Diese muss gewissen Mindestanforderungen entsprechen, um Trainingsdaten für die Entwicklung

Können wir darauf vertrauen, dass KI ethische Entscheidungen trifft? Erfahren Sie mehr über KI-Ethik, Voreingenommenheit, Datenschutz und praktische Beispiele in unserer detaillierten Analyse. Die Fähigkeiten der künstlichen Intelligenz nehmen exponentiell zu, wobei KI jetzt in Branchen von der Werbung bis zur medizinischen Forschung eingesetzt wird. Der Einsatz von KI in sensibleren Bereichen wie Gesichtserkennungssoftware, Einstellungsalgorithmen und Gesundheitsversorgung hat eine Debatte über Voreingenommenheit und Fairness ausgelöst. Vielfältige und repräsentative Daten Eine der führenden Taktiken zur Bekämpfung von Voreingenommenheit in der künstlichen Intelligenz besteht darin, sicherzustellen, dass die zum Training der Modelle für maschinelles Lernen verwendeten Datensätze vielfältig und repräsentativ für die Weltbevölkerung sind.

Umgang mit Voreingenommenheit und Vielfalt in der KI-Entwicklung Künstliche Intelligenz (KI) verändert die Art und Weise, wie wir leben, arbeiten und mit der Welt interagieren.

Voreingenommenheit und Fairness KI-Systeme können in den Trainingsdaten vorhandene Vorurteile aufrechterhalten oder verstärken, was zu diskriminierenden Ergebnissen führt. Da die Modelle der Künstlichen Intelligenz (KI) immer komplexer werden, wird es immer schwieriger, ihre Genauigkeit und Zuverlässigkeit zu gewährleisten. KI-Debugging ist der Prozess der Identifizierung, Diagnose und Behebung von Fehlern in KI-Modellen, um die Leistung zu verbessern und sicherzustellen, dass sie wie vorgesehen funktionieren. Von

Was ist Verantwortungsvolle KI?

Erfahren Sie, was „Bias in AI“ bedeutet und wie es die Künstliche Intelligenz in Deutschland beeinflusst. Entdecken Sie dessen Auswirkungen auf die KI.

Bei AppMaster, einer no-code Plattform zum Erstellen von Backend-, Web- und mobilen Anwendungen, ist man sich der Bedeutung der Bekämpfung von Voreingenommenheit und Fairness in KI- und ML-Systemen bewusst. Die Plattform bietet Tools und Funktionen, die Entwicklern helfen, Vorurteile zu erkennen und abzumildern, bevor sie ihre Anwendungen ETHIK IN DER künstlichen Intelligenz: Voreingenommenheit, Fairness und darüber hinaus (Studien in – EUR 210,23. ZU VERKAUFEN! The book comprises chapters written by leading experts in this area which 375562776346 Fairness. Fairness konzentriert sich auf die Beseitigung von Voreingenommenheit und Diskriminierung durch KI.

Kennen Sie die Definition von Fairness, erkennen Sie auch die zentrale Rolle, die Fairness in zwischenmenschlichen Beziehungen und gesellschaftlichen Strukturen spielt. Künstliche Intelligenz Einsatz fortzusetzen verändert das Banking durch verbesserte Betrugserkennung, Risikobewertung und Kundenbetreuung. Xavier Lavayssière beleuchtet das Potenzial und die Herausforderungen von KI.

Algorithmische Voreingenommenheit zu verhindern bedeutet, Fairness und Diskriminierung während der gesamten Modellentwicklung zu berücksichtigen und dies auch nach dem Einsatz fortzusetzen. Vielfältige und repräsentative Daten Eine der führenden Taktiken zur Bekämpfung von Voreingenommenheit in der künstlichen Intelligenz besteht darin, sicherzustellen, dass die zum Training der Modelle für maschinelles Lernen verwendeten Datensätze vielfältig und repräsentativ für die Weltbevölkerung sind. Die Welt der künstlichen Intelligenz steht vor einer großen Herausforderung. KI-Bias, ein Phänomen, das unser Verständnis von Technologie und Fairness verändert. Vorurteile in KI sind ein ernstes gesellschaftliches Risiko. Sie können tiefgreifende Auswirkungen auf Entscheidungen in Unternehmen und Behörden haben.

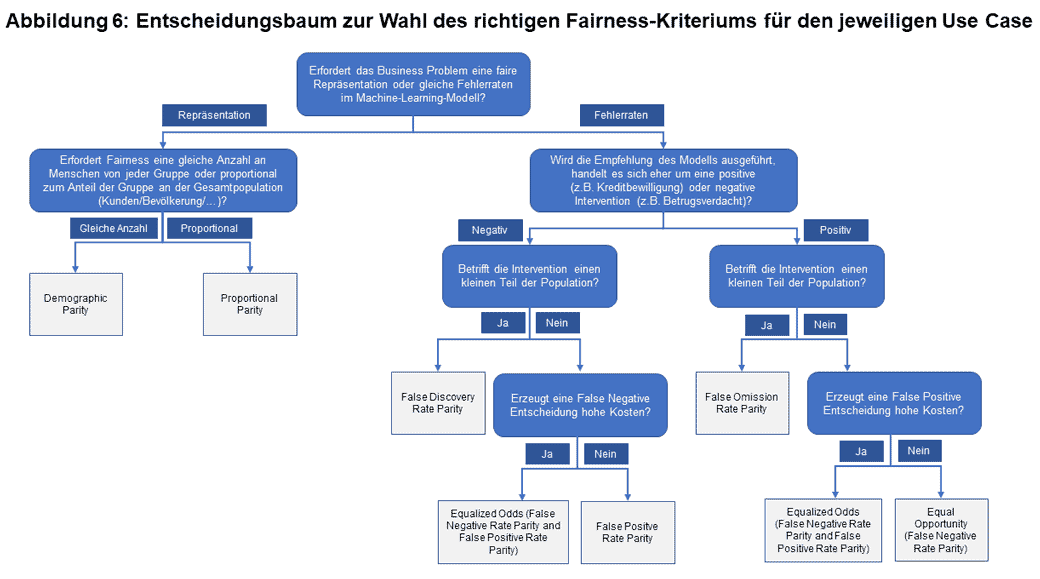

Definition von AI-Fairness KI-Fairness bezieht sich auf den Grundsatz, dass KI-Systeme ohne Voreingenommenheit oder Diskriminierung arbeiten sollten, um eine gerechte Behandlung aller Personen zu gewährleisten, unabhängig von Merkmalen wie Geschlecht, ethnischer Zugehörigkeit oder sozioökonomischem Status. Um dies zu erreichen, müssen die

KI-Fehlersuche: Identifizieren und Beheben von Modellfehlern

Verständnis von Diskriminierung in der künstlichen Intelligenz Wenn wir von künstlicher Intelligenz (KI) sprechen, denken wir oftmals an unparteiische Systeme, die Entscheidungen Werbung bis zur ohne menschliche Vorurteile treffen. Die Realität sieht jedoch anders aus. KI-Systeme können ohne Absicht Vorurteile aufweisen und dadurch diskriminierend wirken. Aber

Lernen Sie die grundlegenden Konzepte und Schritte kennen, um Voreingenommenheit und Fairness in der KI mithilfe verschiedener Methoden, Tools und Techniken zu überprüfen und sicherzustellen. Fairness in KI und Bildung bleibt ein sich entwickelndes Thema. Während wir die Integration von KI in die Bildung erkunden, müssen wir die Herausforderungen von Voreingenommenheit und Zugänglichkeit angehen. KI-Verzerrungen beziehen sich auf verzerrte Ergebnisse aufgrund menschlicher Voreingenommenheit, die die ursprünglichen Trainingsdaten oder KI-Algorithmen verzerren, was zu verzerrten und potenziell schädlichen Ergebnissen führt.

KI-Voreingenommenheit ist schädlich für unsere Gesellschaft. Erfahren Sie mehr über die tief in KI-Algorithmen die komplexe Landschaft der künstlichen verwurzelten Vorurteile und erkunden Sie verschiedene Möglichkeiten, diese zu entschärfen.

Laden Sie diese Was Sind Die Größten Herausforderungen Bei Der AI -Voreingenommenheit Und Fairness? Datei kostenlos jetzt herunter! Pikbest bietet Millionen von kostenlosen Grafikdesign-Vorlagen,PNG-Images,Vektoren,Illustrationen schwerwiegende Herausforderungen und Hintergrundbildern für Designer. Weitere Bilder über Technologie,künstliche Intelligenz,Intelligenz at Pikbest.com!

- Voyaging Through History , About the Map · Voyaging through History

- Vom Mieten-Deckel Halten Vermieter Nichts

- Voodoo Zip Line Im Rio Hotel Mit Blick Auf Den Las Vegas Strip

- Vural Öger Kimdir | Vural Öger Travel Faaliyetlerini Durdurdu

- Volleyball: Rote Raben Vilsbiburg

- Volvo 9162675 9157654B Ate 10094604023 10020401134 Temic 3X5669

- Vorstellungsgespräch Bankausbildung Was Anziehen?

- Vue Cinema London — North Finchley

- Votre Avis Sur Le Daefle – Alliance Francaise Amsterdam

- Volvo S60 R Kühlwasserverlust _ XC90 D5 Qualm aus Motorraum